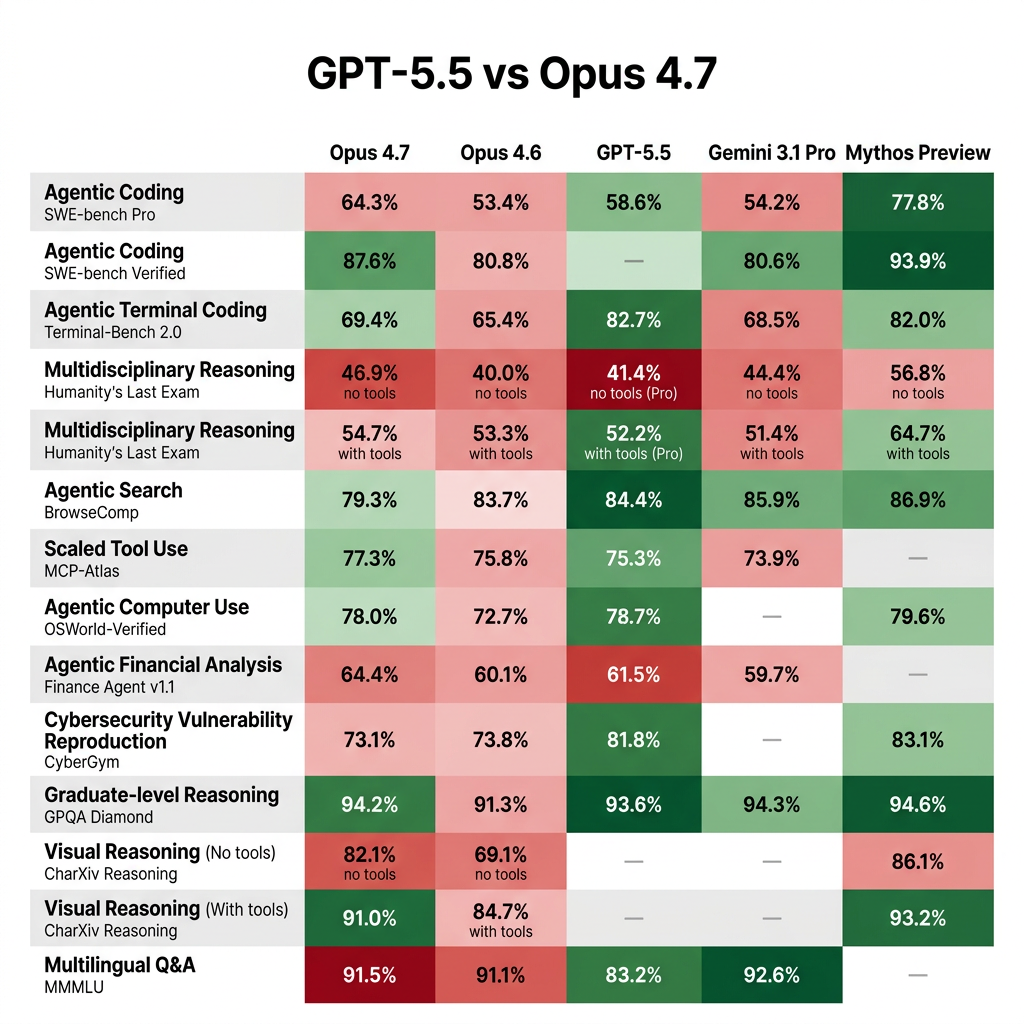

Bagi yang mengikuti perkembangan AI, sebuah tabel kembali beredar di berbagai platform. Judulnya sederhana, “GPT-5.5 vs Opus 4.7”, dengan deretan angka yang membandingkan performa lima model AI besar di sebelas jenis pengujian. Ada Opus 4.7 dan pendahulunya Opus 4.6 dari Anthropic, GPT-5.5 dari OpenAI, Gemini 3.1 Pro dari Google, dan satu kolom misterius berlabel Mythos Preview yang angka-angkanya mencolok di hampir semua baris.

Tabel itu, seperti banyak tabel benchmark lainnya, mengundang pertanyaan yang sama, siapa pemenangnya?

Jawabannya, ternyata, tidak sesederhana yang dibayangkan. Dan justru di sanalah letak ceritanya.

Tujuh Kategori, Tujuh Cerita

Kalau diperhatikan baris demi baris, tabel itu sebenarnya bukan satu pertandingan, melainkan tujuh pertandingan berbeda yang kebetulan dimainkan oleh peserta yang sama.

Pada agentic coding, kategori yang menguji kemampuan AI menyelesaikan masalah pemrograman dunia nyata, Opus 4.7 memimpin telak dengan skor 64,3% di SWE-bench Pro, mengungguli GPT-5.5 yang berada di 58,6%. Gemini 3.1 Pro tertinggal di 54,2%. Lompatan ini bukan sekadar angka di atas kertas. Mitra pengujian seperti Rakuten melaporkan model ini menyelesaikan tiga kali lebih banyak tugas produksi dibandingkan pendahulunya.

Tetapi ceritanya berbeda di agentic terminal coding, kategori yang menguji kemampuan AI bekerja di lingkungan command-line. Di sini GPT-5.5 unggul jauh dengan 82,7%, sementara Opus 4.7 hanya mencapai 69,4%. Beralih ke agentic search, kemampuan menjelajahi dan meringkas informasi dari web, Gemini 3.1 Pro justru muncul sebagai pemimpin dengan 85,9%, mengungguli GPT-5.5 dan meninggalkan Opus 4.7 yang malah mengalami penurunan dari versi sebelumnya.

Pada cybersecurity vulnerability reproduction, GPT-5.5 kembali memimpin dengan 81,8%. Opus 4.7 sengaja dirancang untuk tidak unggul di sini. Anthropic menyatakan secara terbuka bahwa selama pelatihan, mereka justru mencoba mengurangi kemampuan ofensif siber model ini, sebuah pilihan etis yang dibuat sadar, bukan kelemahan yang tak disengaja.

Untuk multilingual Q&A, kategori yang menguji pemahaman lintas bahasa, Opus 4.7 kembali memimpin dengan 91,5%, hanya berbeda tipis dari Gemini di 92,6%, sementara GPT-5.5 tertinggal cukup jauh di 83,2%.

Kolom yang Mencurigakan di Ujung Kanan

Di kolom paling kanan tabel, ada satu nama yang menarik perhatian, Mythos Preview. Skornya nyaris selalu tertinggi di setiap baris. Reasoning multidisiplin 56,8%, agentic coding 77,8%, visual reasoning 86,1%. Sekilas, ini adalah pemenang sejati.

Tetapi label “Preview” di belakang namanya bukan tanpa makna. Mythos adalah model paling canggih milik Anthropic yang sengaja tidak dirilis ke publik secara luas. Ia hanya tersedia untuk mitra terpilih, terutama yang berkaitan dengan riset keamanan siber tingkat lanjut. Kehadirannya di tabel berfungsi sebagai semacam “langit-langit”, penunjuk seberapa jauh teknologi ini sebenarnya bisa pergi, sekaligus pengingat bahwa Anthropic memilih untuk tidak melepasnya begitu saja.

Pilihan menahan model paling kuat ini menarik untuk direnungkan. Di tengah persaingan industri AI yang semakin ketat, sebuah perusahaan justru memutuskan tidak melempar amunisi terbaiknya ke pasar terbuka. Alasan resminya, masalah keamanan dan dampak yang belum sepenuhnya bisa diprediksi.

Apa Sebenarnya yang Sedang Diperebutkan?

Membaca tabel ini lebih seksama, ada pergeseran yang mungkin tidak banyak disadari pembaca awam. Beberapa tahun lalu, perlombaan AI berfokus pada satu pertanyaan, model mana yang paling pintar? Pertanyaan itu kini sudah usang. Pada GPQA Diamond, ujian penalaran tingkat pascasarjana, ketiga model utama mencatat skor di kisaran 93-94%. Perbedaan di antara mereka praktis tidak signifikan secara statistik.

Pertarungan sesungguhnya sudah berpindah. Yang kini diperebutkan bukan lagi siapa yang paling pintar, melainkan siapa yang paling andal mengeksekusi tugas-tugas multi-langkah yang panjang. Siapa yang tool errornya paling sedikit. Siapa yang bisa bertahan menyelesaikan pekerjaan berjam-jam tanpa kehilangan fokus. Siapa yang outputnya paling konsisten dengan instruksi.

Inilah sebabnya benchmark seperti MCP-Atlas, yang menguji koordinasi multi-tool, dan Finance Agent, yang menguji analisis keuangan multi-langkah, kini lebih relevan dibandingkan tes IQ tradisional ala GPQA. Opus 4.7 memimpin keduanya, dan itu bukan kebetulan, melainkan hasil dari arah investasi Anthropic yang memang memprioritaskan keandalan agentik dibandingkan sekadar kecerdasan mentah.

Pelajaran untuk Kita yang Bukan Engineer

Lalu apa relevansinya bagi pengguna biasa, bagi akademisi, jurnalis, atau praktisi non-teknis yang menggunakan AI untuk pekerjaan harian?

Tabel itu mengajarkan satu hal sederhana, tidak ada AI terbaik secara mutlak. Ada AI terbaik untuk kebutuhan tertentu. Untuk pekerjaan menulis dan analisis lintas bahasa, Opus 4.7 dan Gemini menjadi pilihan kuat. Untuk pencarian dan sintesis informasi web, Gemini sedikit unggul. Untuk pekerjaan terminal dan otomasi sistem, GPT-5.5 punya keunggulan yang nyata.

Pemilihan AI, dengan kata lain, makin mirip dengan pemilihan kendaraan. Sedan, SUV, dan truk semuanya bisa membawa orang dari titik A ke titik B, tetapi pilihan terbaik bergantung pada medan, beban, dan tujuan. Memaksakan satu model untuk semua kebutuhan adalah cara berpikir lama yang segera akan tertinggal.

Pelajaran yang lebih dalam, mungkin, adalah pelajaran tentang membaca tabel itu sendiri. Angka tanpa konteks bisa menyesatkan. Mythos Preview yang tampak superior ternyata bukan pilihan yang tersedia. CyberGym yang dimenangkan GPT-5.5 ternyata bukan kategori yang dikejar Anthropic. Agentic search yang dimenangkan Gemini ternyata mengalami regresi pada Opus 4.7, dan regresi ini diakui terbuka oleh pembuatnya, bukan disembunyikan.

Di era ketika informasi tentang AI membanjir di linimasa, kemampuan membaca data dengan kritis menjadi keterampilan yang sama pentingnya dengan kemampuan menggunakan AI itu sendiri. Tabel benchmark, sebagaimana statistik lainnya, hanya berbicara jujur kepada mereka yang tahu cara mendengarkannya.